[AI] 2. 불균형 이진분류 문제에서의 모델 평가

![[AI] 2. 불균형 이진분류 문제에서의 모델 평가](https://storage.ghost.io/c/17/be/17be79cb-cb85-4821-86d0-f1611eeee9a3/content/images/size/w960/2026/05/image-1.png)

이진분류 문제, 예를들어 고객이 이 제품을 구매할 지 말 지와 같이 0 또는 1의 결과만 있는 문제의 경우 현실 세계에서는 고객의 제품 구매와 같이 0과 1의 비율이 매우 불균형한 경우가 많다.

즉, 지도학습모델의 레이블(정답지) 관점에서 보면 1(구매한 비율)보다 0(구매하지 않은 비율)이 훨씬 많은 경우가 대부분이다.

우리는 일반적으로 이진분류 모델을 학습하고 나서 해당 모델이 잘 만들어 진 것인지 확인하기 위해 정답지가 있는 테스트셋을 통해 실제로 테스트셋 데이터를 모델에 흘려 추론해보고 모델이 예측한 0, 1의 결과와 실제 0, 1의 결과를 비교해 모델의 성능을 가늠해 보게된다.

이때 가장 많이 활용되는 평가지표가 AUC(Area Under the Curve)이다.

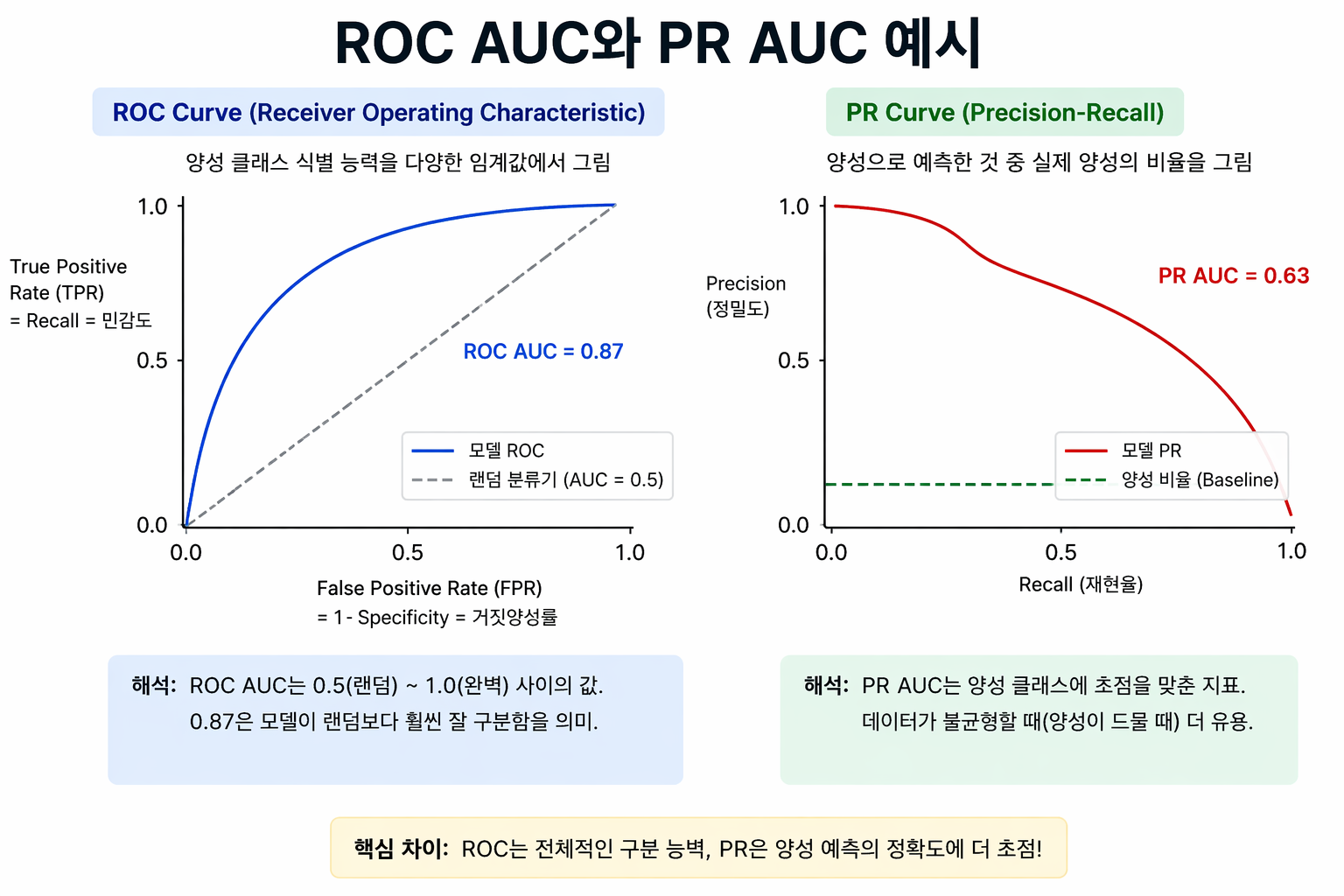

AUC 중에 가장 많이 언급되는 것은 ROC-AUC로 일명 ROC Curve를 그려보고 curve 밑의 면적을 구해 이를 ROC-AUC 값으로 취해 모델의 성능을 파악하게 된다.

<ROC Curve>

X축 : Recall(TPR이라고도 부름), 실제 참 중에 모델이 참으로 예측한 비율

Y축 : FPR, 실제 거짓 중에 모델이 참으로 예측한 비율

-> 거짓의 결과에도 균형있게 검토

-> 모델이 보수적으로 참을 예측하면, FPR은 내려가고, Recall도 떨어짐

-> 모델이 비보수적으로 참을 예측하면(모두 참이라고 하면), FPR은 올라가고, Recall도 올라감

반면 PR-AUC는 Precision-Recall Curve를 그려보고 curve 밑의 면적을 파악하게 된다.

<PR Curve>

X축 : Precision, 모델이 참으로 예측한 것 중에 실제 참의 비율

Y축 : Recall(TPR이라고도 부름), 실제 참 중에 모델이 참으로 예측한 비율

-> 즉, 참의 결과와 예측에만 집중함.

-> 모델이 보수적으로 참을 예측하면, Precision은 올라가고, Recall은 떨어짐

-> 모델이 비보수적으로 참을 예측하면(모두 참이라고 하면), Precision은 내려가고, Recall은 올라감

PR Curve 및 이를 바탕으로 도출되는 PR-AUC는 참의 결과와 예측에만 집중하기 때문에 참/거짓 중 참의 비율이 매우 작은 불균형 데이터에 더 적합한 평가지표가 된다.

아래는 두 커브와 AUC의 비교 예시다.

주목할 점은 ROC AUC의 경우 0.5의 값을 갖게되면 랜덤 분류기의 결과에 해당하기 때문에 ROC AUC 값이 항상 0.5 보다 커야 좋은 모델이라는 평가를 하게 되지만 PR AUC의 경우 0.5와 같은 고정된 비교값이 없다. 대신 위의 그림에도 있듯이 실제 데이터셋의 양성 데이터 비율에 따라 PR AUC 값의 좋음 정도가 결정된다.

예를 들어:

- 양성 비율 = 10% → 랜덤분류기인 경우 PR AUC ≈ 0.1

- 양성 비율 = 1% → 랜덤분류기인 경우 PR AUC ≈ 0.01

실무적으로는 양성비율에 따른 기준 PR AUC 대비 모델의 AUC값이 2배이상은 되어야 하고, 5배는 되어야 좋은 모델이라고 할 수 있음.