보이지 않는 의미를 ‘방향 벡터’로 꺼내는 기술

들어가며

LLM 임베딩을 어느 정도 다뤄본 사람이라면 이 질문에 반드시 도달한다.

“이 임베딩 공간에서

구매 의사, 프리미엄 구매 성향 같은 ‘의미 축’을

실제로 어떻게 뽑아내지?”

의미 축(axis)은

- 설명 가능한 추천

- 고객 페르소나 벡터

- 선형 분리 평가

의 핵심 재료다.

한 문장 요약

의미 축이란 ‘차원’이 아니라

임베딩 공간에서 특정 개념이 증가하는 ‘방향 벡터’다.

1.먼저 짚고 가야 할 오해

(X) “임베딩의 n번째 차원이 구매 성향이다”

(X) “PCA 1축 = 의미 축이다”

LLM·행동 임베딩에서

개별 차원은 거의 해석 불가능하다.

→ 의미는 항상 여러 차원의 조합 = 방향(direction) 에 있다.

2.의미 축 추출의 대표적 방법 5가지

방법 1. 차이 벡터 (Difference Vector) — 가장 강력하고 실무적

개념

두 집단의 평균 임베딩 차이를 의미 축으로 정의한다.

axis = mean(Positive Group) - mean(Negative Group)

예시

- 구매 고객 vs 미구매 고객

- 프리미엄 구매자 vs 가성비 구매자

- 가족 가구 vs 1인 가구

해석

- 어떤 임베딩 v에 대해dot(v, axis) ↑→ 해당 성향이 강함

→ 설명 가능성 · 안정성 · 재현성 모두 우수

중요한 점:

- 절대값 (X)

- 상대적 비교 (O)

방법 2. 선형 분류기 weight — “모델이 찾은 의미 축”

개념

Logistic Regression / Linear SVM의

weight 벡터 = 의미 축

y = sigmoid(w · x + b)여기서 w가 바로:

“이 라벨을 가장 잘 구분하는 방향”

왜 이게 의미가 있을까?

- 분류 성능이 잘 나올수록

- w는 해당 라벨을 가장 잘 설명하는 방향

즉,

“이 방향으로 갈수록

더 구매자답다 / 더 이탈 위험이 높다”

장점

- 다운스트림 성능과 직결

- 선형 분리성 평가와 자연스럽게 연결

주의

- 라벨 정의가 곧 의미 정의

- 과도한 편향 가능성

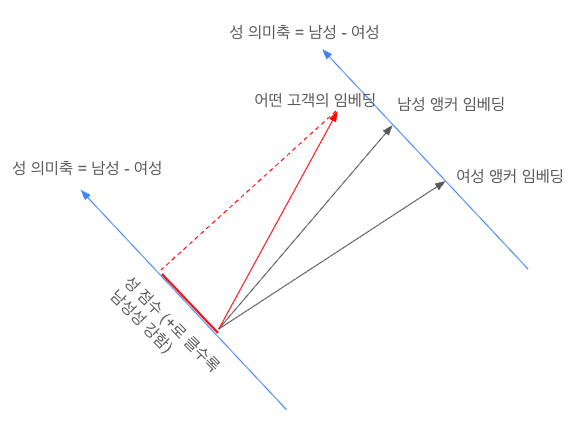

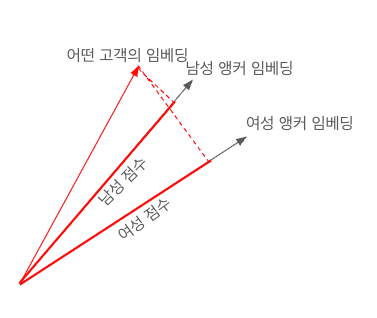

방법 3.앵커(Anchor) 기반 축 — 라벨이 없을 때

개념

명확한 의미를 가진 기준 텍스트/행동을 앵커로 삼는다.

axis = embedding("구매 의사가 강한 고객 행동 설명")또는

axis = mean(anchor_positive_texts)

활용 예

- “프리미엄 제품을 선호하는 고객”

- “설치/AS를 중요하게 여기는 고객”

→ Zero-shot 의미 축 생성 가능

방법 4. PCA/PLS 기반 — 구조에서 의미 찾기

PCA

- 분산이 가장 큰 방향

- 행동 데이터에서는종종 “주요 행동 흐름”과 일치

PLS

- 타깃 변수와 공분산 최대화

- 의미 축 추출에 PCA보다 적합한 경우 많음

! 단점

- 의미가 항상 명확하지 않음

- 해석은 사후 검증 필수

방법 5. Contrastive 학습으로 축을 직접 학습

개념

의미 축 자체를 학습 목표로 둔다.

- (구매, 미구매) 쌍

- (프리미엄, 가성비) 쌍

→ 해당 대비가 가장 잘 드러나는 방향을 모델이 직접 학습

장점

- 명확한 축

- 노이즈에 강함

단점

- 학습 비용 ↑

- 실험 난이도 ↑

3.추출한 의미 축이 ‘좋은지’ 확인하는 법

체크 1. 극단값 샘플 검증

- 축 투영값 Top-N / Bottom-N

- 실제 행동·텍스트를 사람이 직접 확인

→ 사람의 직관과 맞는가?

체크 2. 다운스트림 성능

- 축 값 하나만으로

- 구매 / 이탈 / 선호 예측이 되는가?

→ 단순할수록 좋다

체크 3. 축 간 관계

- 축 간 코사인 유사도

- 너무 비슷하면 중복 축

→ 완전 독립일 필요는 없지만 완전 중복은 피한다

4. 실무에서 가장 많이 쓰는 조합 전략

차이 벡터 + 선형 모델 weight

- 약한 기준으로 집단 정의

- 차이 벡터로 초기 축 생성

- 선형 모델로 미세 조정

- 해석 가능한 축으로 고정

→ 가장 비용 대비 효과가 좋다

5. 흔한 실패 패턴

(X) 차원 하나를 의미로 해석

(X) PCA 축을 그대로 의미 축이라 주장

(X) 축 검증 없이 바로 비즈니스 적용

(X) 절대값에 집착 (상대 비교가 핵심)

한 문장으로 정리하면

의미 축은 ‘숫자 하나’가 아니라

임베딩 공간에서

개념이 커지는 방향이다.

마치며

임베딩 공간에서

의미 축을 추출하는 순간,

- 임베딩은 블랙박스가 아니게 되고

- 고객은 벡터가 아니라 성향이 되며

- 추천은 점수가 아니라 이유를 갖는다

의미 축은

임베딩을 ‘이해 가능한 도구’로 바꾸는 열쇠다.